在机器视觉行业中,视觉系统的进步往往被等同为看得更清楚。但我们把视角从实验室或Demo现场转向真实产线,就会发现,这一逻辑正在逐渐失去部分的解释力。越来越多项目的瓶颈,并不在于“看不清”,而在于信息不完整、系统不稳定以及难以适配变化。换句话说,是“看得见,却不好用”。这种“不好用”往往不会体现在单次演示中,却会在长期运行中被不断放大,最终演变为调试周期冗长、对环境高度敏感以及方案难以复制等一系列工程问题。

也正是在这个意义上,机器视觉正在发生一个关键转变,它不再只是一个“技术问题”,而逐渐演变为“工程与系统问题”。而海康机器人在今年Vision China中所呈现的产品和场景能力,实则是在解决一个更底层的问题:当视觉能力不再稀缺时,如何让它真正成为一种可以被规模化使用的工业能力。

这一变化也可以归结为一个更核心的需求额命题,那就是我们要的视觉产品和系统是要能“理解制造”。这种理解,并不只是识别结果的准确与否,而是体现在信息获取是否全面、空间表达是否完整,以及系统是否能够在复杂工况下稳定运行。

围绕这一目标,我们也发现了海康机器人产品和方案能力的演进路径:算法能力→设备能力→场景覆盖能力→真实痛点的解决能力。

在工业检测领域,很常见的痛点是单一图像很难同时承载多种类型的缺陷信息。尤其是在PCB、电芯等反射属性各异的材料上,划痕、脏污与凹坑分别对应不同的光学响应机制,即便分辨率再高,单一维度的成像方式也难以兼顾。

在这一背景下,海康机器人高速线D视觉检测系统的意义,不在于单一性能的提升,而在于对“信息结构”的重构,获取高维度信息是视觉方案成功与否的关键。通过线阵相位投影成像技术,在一次扫描过程中获取多种光学响应,输出标准图、漫反射图、镜面图、光泽比图及形状图等多类型结果图,并提取不同于2D与3D成像技术的高维深度变化信息,可覆盖全类型缺陷,实现复合检测效果。系统实际上将原本依赖单张图像的检测逻辑,转变为基于多信息融合的判断方式。

这一变化的意义在于将原本高度依赖经验的、非标准化的“选图过程”,转化为更加可控的数据组合过程,从而显著降低调试复杂度,并提升方案的稳定性与可复制性。在实际应用中,这种方式能够稳定识别PCB板表面的轻微划伤、脏污、凹坑、异物等多类缺陷。

但更值得注意的是,这种“看得更全”的能力,只有在系统能够实时处理的前提下才有意义。大量图像数据如果无法在产线节拍内完成处理,反而会成为新的瓶颈。

那么,自然就会有朋友要问了,高算力和处理大量数据影响稳定性的问题如何解决?

据现场介绍,海康机器人在底层配备了2.5D视觉检测系统的专用工控机,通过高性能处理器平台与DDR5高速内存架构,并支持GPU扩展与视觉算法加速,使多通道图像融合与高精度相位解调能够在高负载条件下稳定运行。也就是说,即便多相机并行满载采集的极限工况下,依然可以实现多结果图的实时输出且不掉帧,从而与产线节拍保持一致。

这一点其实也说明了,我们所说的视觉能力的上限,不仅取决于算法本身,还取决于底层算力架构是否能够支撑系统稳定运行。

类似的思路也体现在海康机器人穹顶光2.5D系统中,通过分区照明与光度立体算法的结合,并支持线扫成像,该系统能够在物体运动过程中完成采集与融合,从而在保证检测精度的同时,还能满足产线的高节拍要求。

从这一系列变化可以看到,在更加细分的检测场景中,大家的竞争方向正在发生迁移:看得清是过去式,现在不仅要看得全,还得跑得又快又稳。

如果说2.5D系统解决的是信息维度问题,那么3D视觉所面对的,则是空间表达的问题,这个的实现难度不用过多阐述。在实际工程中,3D方案失败的原因,很少是单纯的精度不足,反而更多来自于空间信息的不完整,例如测量盲区、点云不连续以及多设备之间难以融合。

这些问题本质上都指向同一个核心,空间是否能够被完整建模。我们还是类比人眼,人眼是站在上帝视角把物体的全貌看清楚,那么对于它的各个位置、形状、大小的各项细节会了如指掌。同样的,在产线和工况复杂的场景中,如果视觉系统能够站在上帝视角,那么它能解决的场景将会非常丰富。

而海康机器人最近推出的3D测量的多种方案,实际上都围绕这一问题展开。例如,在新品DS高精度面结构光系统中,通过移相编码与多帧曝光融合,使其在复杂反光环境下仍能输出稳定点云,并实现对BGA锡球高度、共面度与位置度的高精度测量。然而,其真正价值并不只是精度本身,而在于能够持续输出“连续、可用”的空间数据。

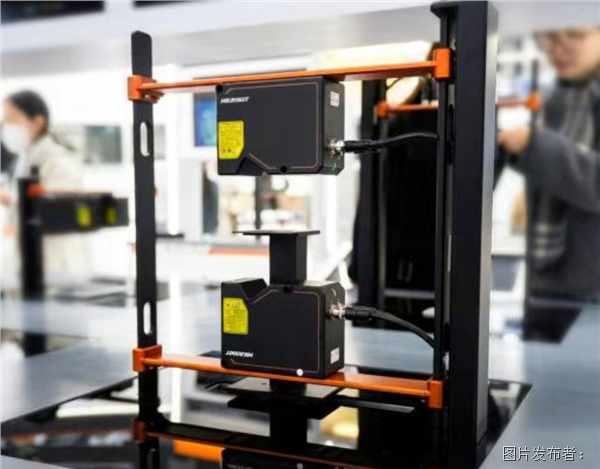

在折叠屏铰链检测场景中,通过双目单线激光轮廓传感器的视野融合,不仅消除了传统三角测量带来的盲区,还通过公共视野提升了信噪比,从而有效抑制金属杂光干扰,使空间信息从“局部可见”转向“整体可用”。

在散热片测厚以及管道360°检测方案中,通过对射结构与环视拼接,实现了非接触式的全域扫描与实时三维重建,从而避免了传统测量方式中的漏检与结构误判问题。

这些方案虽然应用各异,但底层逻辑是一致的,从对“单点或局部”的测量,转向对“整体空间”的理解。当空间能够被完整建模之后,测量、检测与定位不再是独立任务,而成为空间理解的自然结果。

前文说到,看得清是过去式,那么自动化系统的升级也容易被简单理解为“执行得更准”。但在真实工业现场环境始终是不确定的,而传统自动化却建立在确定性前提之上,所以,我们现在的非标项目越来越多,定制化产品也越来越多,那么成本自然也就上星空体育智能科技升了。工件形变、来料偏差以及多设备协同误差,会不断打破预设路径的有效性,使得依赖固定流程的系统难以长期稳定运行。

那么,怎么解决?难道还是遇事不决上AI?不,还要加上视觉能力,最好还得是3D视觉。

这一点在海康机器人的3D视觉引导方案中体现得尤为明显。无论是五轴点胶系统中基于实时轮廓生成路径,还是螺丝无序抓取中通过点云与算法完成目标选择与避障,本质上都是让执行过程从“预设路径”转向“感知驱动”。而在轮毂装配等复杂场景中,多相机建模与协同调度进一步实现了对动态偏差的实时补偿,使系统能够在变化中保持精度。

但在工业AI落地过程中,一个更深层的瓶颈往往并不在模型本身,而在模型赖以存在的基础“燃料”——数据。尤其是在缺陷检测场景中,企业的良品率都相对可观,导致划痕、脏污、破损等异常属于稀缺事件,这使得模型训练长期面临“数据不足却必须上线”的现实约束。

针对这一关键问题,海康机器人将大模型在线样本生成能力引入到智能产品线之中,从源头重构数据获取方式。通过对正常产品图像进行深度学习,系统可以在输入缺陷类型(如“划痕”“脏污”)后,自动生成具有真实光照、材质与结构变化的高逼真缺陷样本,不仅能够模拟常见异常,还可以覆盖长尾甚至极端工况。

这一能力的意义,我们认为并不仅仅在于补充数据规模,更重要的是它将原本依赖物理采集的数据获取过程,转化为一种可控、可扩展的数据生成能力,对于降低模型训练对现实采样的高度依赖,和大幅缩短模型从构建到部署的周期,有着非常直观的价值。

另外,海康机器人还展示了大模型算法在数据识别方面的应用。这一模型相比于传统CNN模型在字符识别能力方面就有明显提升,搭载了该模型的海康机器人SC6500P智能相机能够在晶圆不同工艺段依然实现高精度识读。

还有适用于标签缺陷检测SC5000X则通过边缘学习,在少量样本条件下完成模型部署,并实现检测与控制的实时闭环响应,而且能够在产线换型后快速适配。

可以看到,工业AI的价值,并不在于模型是否具备更强的通用性,而在于所依赖的数据是否真正具备场景易用性和可拓展性。数据不再受限于采样成本与稀缺性,而是能够围绕具体场景持续扩展与优化,这使得模型训练从被动积累,转向主动构建。

也正是在这一基础之上,工业AI才有可能真正嵌入设备运行过程之中,并与视觉感知与控制执行形成完整闭环,从“提供判断”走向“参与决策”,从而在复杂且持续变化的工业现场中,具备长期稳定运行的能力与工业化价值。

从整体来看,可以发现一个贯穿始终的变化:海康机器人并不是在单点提升视觉性能,而是在构建一种能够支撑工业现场复杂性的系统“理解”能力。这种能力体现在信息获取的全面性、空间建模的完整性、执行过程的适应性以及AI能力的工程化落地上。

也正是在这个意义上,机器视觉的角色正在发生变化,从“看见世界”,走向“理解制造”。而当这种理解能力逐步建立起来之后,自动化系统的边界才真正被打开,非标场景也才有机会走向可复制的工业能力体系。

专访Thomas Fehn博士:当AI遇上激光,通快在做哪些“看不见”的布局?